Gli agenti IA stanno rapidamente passando da demo impressionanti a strumenti concreti in grado di agire per tuo conto, e OpenClaw è uno dei nomi che ha attirato maggiore attenzione. Potresti aver incontrato lo stesso progetto con altri nomi — Clawdbot o Moltbot — usati in diverse fasi di sviluppo dal suo creatore, lo sviluppatore austriaco Peter Steinberger.

Presentato come un assistente personale “senza mani” in grado di operare software al posto tuo, solleva però questioni rilevanti su accessi e sicurezza.

- Gli agenti IA sono sistemi di intelligenza artificiale capaci di agire, non semplici strumenti conversazionali.

- Strumenti come OpenClaw dimostrano quanto possano essere potenti gli agenti IA autogestiti.

- Questa potenza introduce nuovi rischi di sicurezza quando gli agenti processano input non attendibili.

- L'iniezione di prompt è una minaccia chiave per gli agenti IA, più ancora che per i chatbot.

- La memoria persistente può amplificare errori e prolungare un attacco.

- Gli agenti IA sono potenti, ma non rappresentano un'impostazione sicura per la maggior parte degli utenti.

Perché tanto clamore su OpenClaw?

OpenClaw attira attenzione perché rappresenta il passaggio da IA che rispondono a domande a IA che possono eseguire attività su un sistema reale e persino usare altri software. I potenziali problemi di sicurezza hanno fatto sì che OpenClaw sia diventato un argomento discusso anche nelle comunità di sicurezza. Cosa rende OpenClaw interessante per sviluppatori e utenti avanzati?

OpenClaw si distingue perché può compiere azioni reali, non solo generare testo o suggerimenti. Invece di dirti cosa fare, può farlo da sola. La tecnologia può aprire app, inviare messaggi, spostare file, eseguire comandi e interagire direttamente con sistemi per conto tuo.

Proprio questo livello di automazione suscita interesse. Sviluppatori e utenti avanzati vedono il controllo a livello di sistema come un modo per ridurre lavori ripetitivi o automatizzare flussi operativi. L'idea di un agente IA che «fa il lavoro» invece di limitarsi ad assistere è molto forte.

Questa promessa di capacità operative è il motivo per cui OpenClaw è passato rapidamente da progetto di nicchia a tema di discussione più ampio.

Perché conta oltre OpenClaw

OpenClaw offre un esempio visibile di un cambiamento più ampio verso agenti IA che agiscono realmente, non si limitano a rispondere o consigliare.

Le domande sull'uso improprio diventano inevitabili quando questa tecnologia si diffonde. OpenClaw mostra la direzione verso cui si muove l'ecosistema IA, rendendolo rilevante ben oltre un singolo progetto e aprendo il dibattito su come questi agenti debbano essere regolati. Possono essere considerati affidabili?

Cosa sono gli agenti IA e cosa li distingue dagli altri strumenti IA?

Gli agenti IA non si limitano a fornire risposte testuali o audio alle tue domande. Possono pianificare attivamente passaggi e compiere azioni per raggiungere un obiettivo. Invece di fermarsi al consiglio, decidono cosa fare dopo e lo eseguono.

Un agente IA può osservare una situazione e intervenire. Questo lo differenzia dalla maggior parte degli strumenti IA, che rispondono a prompt ma attendono il comando successivo. Esempi iniziali includono agenti esecutori di attività come Manus (ora di proprietà di Meta). Manus dimostra come gli agenti possano andare oltre la chat per passare all'azione: può analizzare dati o scrivere codice in modo proattivo per risolvere problemi senza dover ricevere istruzioni passo dopo passo. L'intervento umano è ridotto.

OpenClaw si basa su questa stessa idea di agenti IA capaci di agire, ma la applica in modo più diretto e potente.

OpenClaw è un agente IA tipico o qualcosa di più avanzato?

OpenClaw rientra nella categoria degli agenti IA. Offre un'implementazione più potente rispetto a molti strumenti a cui la maggior parte delle persone è abituata.

Questo strumento IA può pianificare attività e agire senza input costanti. OpenClaw può interagire direttamente con software e sistema operativo, non solo con modelli API o strumenti limitati. Questo accesso più ampio ne aumenta l'utilità e lo distingue. Ma alza anche la posta in termini di sicurezza.

Perché gli agenti IA autogestiti sono diversi

Gli agenti IA autogestiti vengono eseguiti localmente sul tuo sistema invece che su un servizio remoto. Questo dà agli utenti maggiore controllo su aspetti come configurazione e comportamento, ma sposta anche la responsabilità.

Quando un agente ha accesso locale, la sicurezza dipende da come è configurato, quali permessi riceve e come viene monitorato. Più controllo significa anche più rischi.

Progetti recenti stanno cambiando l'idea di «self-hosted». Per esempio, Moltbot (precedentemente Clawdbot) può ora essere eseguito usando Moltworker, un progetto open source di Cloudflare. Questo elimina la necessità di hardware locale dedicato permettendo di far girare l'agente su una piattaforma gestita.

Questo abbassa la barriera d'ingresso e semplifica l'installazione, ma cambia anche dove risiede il controllo. Quando un agente viene eseguito su infrastruttura cloud, la sicurezza dipende non solo dall'agente stesso, ma anche da controlli di accesso e da come vengono gestiti dati e permessi sulla piattaforma.

Per esempio, un utente potrebbe collegare un agente IA alla propria email pensando che legga solo i messaggi, mentre la configurazione cloud potrebbe permettergli anche di inviare email, a meno che tale permesso non venga esplicitamente disabilitato.

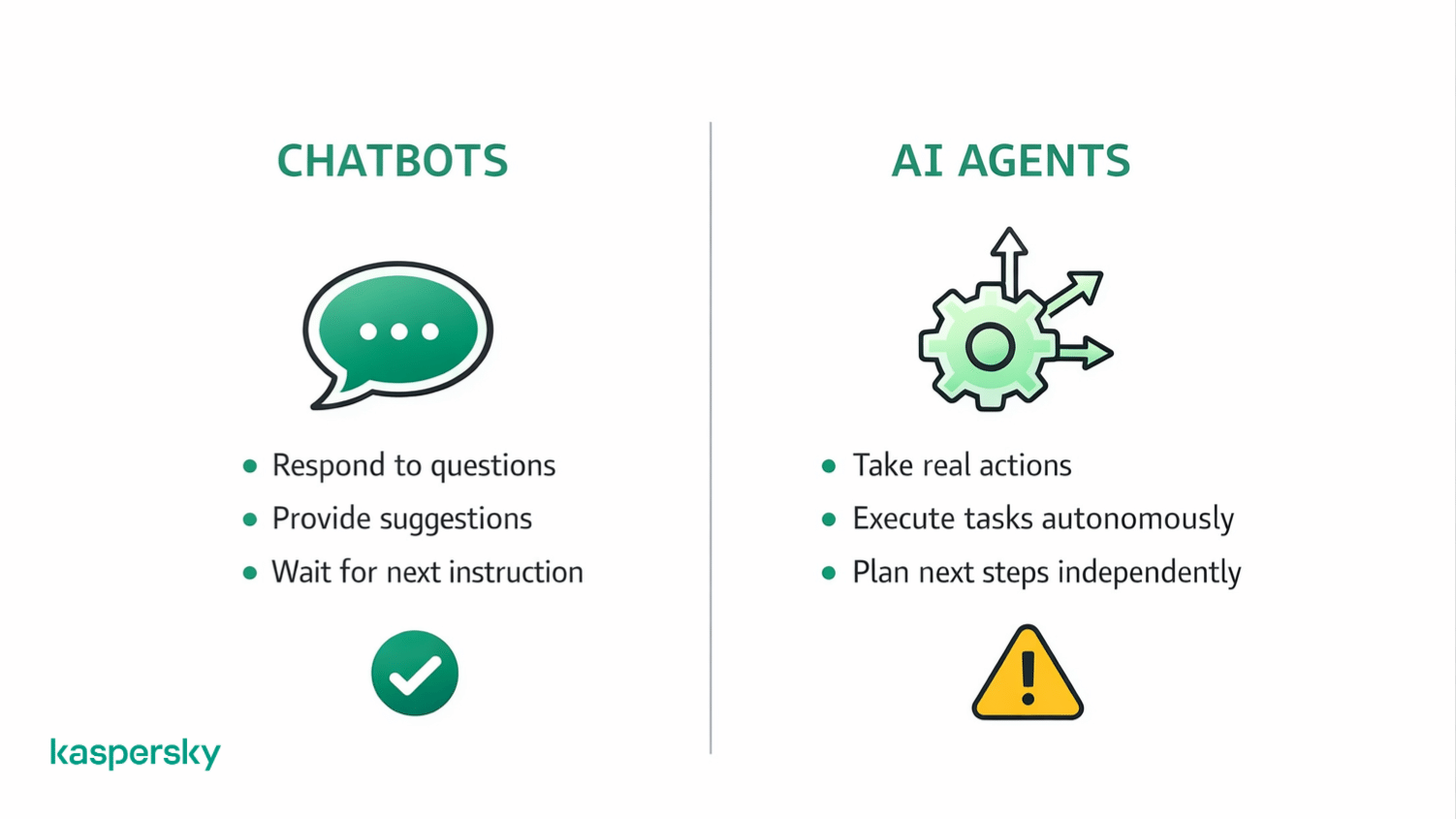

In cosa gli agenti IA differiscono dai chatbot come ChatGPT?

I chatbot come ChatGPT rispondono; gli agenti IA agiscono.

Un chatbot può offrire suggerimenti o spiegazioni. Un agente IA può aprire programmi o completare procedure operative.

Ad esempio, alcune persone hanno usato OpenClaw per automatizzare trading. Hanno definito regole e chiesto all'IA non solo di suggerire azioni (cosa che potrebbe fare anche un chatbot) ma di eseguire concretamente le operazioni di compravendita.

Perché gli agenti IA introducono nuovi rischi per la sicurezza?

Come detto, gli agenti IA compiono azioni anziché limitarsi a dare consigli. Questo spesso comporta accesso a file, applicazioni o funzioni di sistema.

L'accesso di sistema e l'autonomia concessi a OpenClaw cambiano sia l'impatto sia il rischio. OpenClaw può richiedere permessi per interagire con software o per compiere azioni come inviare un'email o compilare moduli senza il tuo controllo diretto. Questo lo trasforma in una carta jolly.

Errori o manipolazioni possono avere conseguenze reali. Il rischio non è solo ciò che si chiede all'agente di fare, ma anche ciò che esso interpreta come istruzioni mentre svolge un compito.

Perché l'input non attendibile è un problema centrale

Gli agenti IA consumano grandi quantità di contenuti esterni (pagine web, documenti, ecc.) per decidere come procedere. Questi contenuti non sono sempre affidabili.

Le istruzioni non devono essere esplicite per essere efficaci. Possono essere nascoste in testo o dati che l'agente legge mentre esegue un compito. Questo permette ad attaccanti di influenzare il comportamento di un agente senza interagire direttamente con esso.

Questo scenario apre la strada all'iniezione di prompt: input non attendibile utilizzato per indurre un agente a compiere azioni che non gli erano state previste.

Strumenti IA potenti richiedono protezioni più forti

Gli agenti IA possono accedere a file, email e funzioni di sistema. Kaspersky Premium aiuta a individuare attività sospette, bloccare script dannosi e proteggere i tuoi dispositivi dalle minacce informatiche reali.

Prova ora Kaspersky Premium gratuitamenteCos'è l'iniezione di prompt negli agenti IA?

L'iniezione di prompt è un metodo per manipolare un agente IA fornendogli contenuti non attendibili che ne alterano il comportamento.

Il rischio non è necessariamente un difetto tecnico nel codice. Il problema è che l'agente può trattare input esterni — come messaggi, commenti o contenuti web — come istruzioni. Quando ciò accade, l'agente può essere guidato a compiere azioni per le quali non era stato progettato.

Come funziona l'iniezione di prompt nella pratica

L'iniezione di prompt può avvenire in modo diretto o indiretto.

- Diretto – un attaccante inserisce intenzionalmente istruzioni nel contenuto che l'agente legge.

- Indiretto – l'agente recepisce istruzioni nascoste o inattese da un sito web o da un messaggio che elabora durante normali attività.

La questione centrale è il comportamento: l'agente potrebbe seguire ciò che interpreta come guida, anche se proviene da fonti non attendibili. Non è necessario che sia presente un bug software per far sì che ciò avvenga.

Perché l'iniezione di prompt è più pericolosa per gli agenti che per i chatbot

Le istruzioni iniettate solitamente alterano le risposte e i consigli dei chatbot. Con gli agenti IA, possono invece influenzare azioni reali.

Se un agente ha accesso a file o controlli di sistema, istruzioni manipolate possono portare a cambiamenti concreti. Per questo l'iniezione di prompt rappresenta un rischio maggiore per gli agenti: la stessa tecnica che altera l'output testuale di un chatbot può scatenare azioni indesiderate quando è coinvolto un agente.

Cos'è la memoria persistente negli agenti IA?

La memoria persistente permette a un agente IA di conservare informazioni nel tempo. Invece di ricominciare da capo per ogni attività, può usare input passati per orientare decisioni future.

Cosa significa la memoria persistente per gli agenti IA

Un agente IA può memorizzare contesto e istruzioni tra sessioni e sviluppare preferenze o «comportamenti» ricorrenti. Questo aiuta l'agente a lavorare in modo più efficiente ricordando ciò che ha imparato o fatto in passato.

Significa anche che input precedenti possono influenzare comportamenti successivi. Istruzioni o assunzioni acquisite in un compito precedente potrebbero ancora modellare l'azione dell'agente in una situazione diversa, anche se l'utente non ne è più consapevole.

Perché la memoria persistente aumenta i rischi per la sicurezza

La memoria persistente può introdurre effetti ritardati. Un'istruzione dannosa potrebbe non causare problemi immediati, ma riemergere più avanti quando si verificano determinate condizioni.

Questo rende la bonifica più difficile. Il comportamento memorizzato può ripetersi su più attività. Ripristinare completamente un agente potrebbe richiedere di cancellare la memoria o ricostruire la configurazione per assicurarsi che le influenze indesiderate siano state rimosse.

Cosa succede quando un agente IA è mal configurato o esposto?

Un agente IA può essere raggiunto o influenzato in modi che il proprietario non aveva previsto, trasformando uno strumento utile in un potenziale rischio per la sicurezza.

Questo può accadere per accidente o fraintendimento, ma anche se terze parti provano a manipolare l'agente.

Come gli agenti IA possono essere esposti involontariamente

L'esposizione spesso deriva da errori banali. Qualcosa di semplice come autenticazione debole o permessi troppo ampi può rendere un agente raggiungibile dall'esterno del suo ambiente previsto.

Eseguire un agente localmente non lo rende automaticamente sicuro. Se si connette a internet o interagisce con altri sistemi, può essere influenzato. Il controllo locale riduce alcuni rischi, ma non li elimina.

Perché gli agenti esposti diventano superfici d'attacco

Una volta esposto, un agente IA diventa qualcosa che gli attaccanti possono sondare, testare e manipolare. Potrebbero cercare di alimentarlo con input studiati ad arte, innescare azioni o capire come si comporta nel tempo.

Poiché gli agenti possono compiere azioni reali, un abuso non deve assomigliare a un attacco informatico tradizionale. L'uso improprio può consistere nel pilotarne il comportamento, estrarre dati o provocare cambiamenti indesiderati nel sistema, il tutto senza sfruttare un difetto software classico.

Cos'è la “triccarica letale” nella sicurezza degli agenti IA?

La «triccarica letale» descrive tre condizioni che insieme creano un rischio serio per la sicurezza degli agenti IA.

Le tre condizioni che permettono attacchi gravi

- La prima condizione è l'accesso a dati sensibili, come file, credenziali o informazioni interne.

- La seconda è l'input non attendibile, ossia quando l'agente elabora contenuti che non può verificare completamente.

- La terza è la capacità di compiere azioni esterne, come inviare richieste, modificare sistemi o eseguire comandi.

Singolarmente, questi fattori possono essere gestibili. Diventano pericolosi quando si uniscono in questa combinazione. Un agente che legge input non attendibili e può agire su di essi crea una via chiara per la manipolazione. Controllare quali azioni un agente è autorizzato a eseguire è fondamentale.

Gli utenti comuni dovrebbero usare agenti IA oggi?

Per la maggior parte delle persone, gli agenti IA restano strumenti sperimentali. Possono essere utili in contesti appropriati, ma comportano anche rischi nuovi che non sono sempre evidenti.

Quando ha senso usare un agente IA

Un agente IA può avere senso in scenari controllati e a basso rischio, ad esempio sperimentando su un dispositivo separato. Alcuni utenti provano agenti che gestiscono solo attività non sensibili, come organizzare file o testare flussi di lavoro.

Per esempio, potresti usare l'agente per creare un itinerario per un viaggio: può accedere alle informazioni necessarie ma essere impedito dall'inviare messaggi diretti o compiere azioni potenzialmente dannose.

Se sai gestire le impostazioni e le possibili conseguenze non sono critiche, un agente può essere uno strumento didattico. La regola è limitare l'ambito e tenere gli accessi strettamente controllati.

Quando gli agenti IA sono una cattiva idea

Gli agenti IA sono sconsigliati quando hanno accesso a dati sensibili o account importanti. Eseguirli senza comprendere i permessi o i pericoli degli input esterni aumenta rapidamente il rischio.

È anche legittimo scegliere di non usarli. Rinunciare a far girare un agente IA è una decisione ragionevole se la comodità implica un compromesso sulla sicurezza o sulla serenità.

Quali misure di base sono essenziali quando si usano agenti IA?

Misure di protezione elementari aiutano a ridurre i rischi e a evitare che gli errori diventino problemi gravi.

Il software di Kaspersky può aggiungere un ulteriore livello di protezione segnalando comportamenti sospetti e contribuendo a proteggere account e dispositivi dalle intrusioni. I nostri piani bloccano minacce che vanno da malware e virus a ransomware e spyware.

Quali misure di sicurezza contano di più

L'isolamento è fondamentale. Esegui gli agenti su dispositivi e account separati quando possibile, così non possono influenzare dati o sistemi importanti. Limita i permessi a ciò che l'agente davvero necessita. Raccomandiamo di evitare di concedere accesso completo al sistema o agli account come impostazione predefinita.

Anche i passaggi di approvazione sono importanti. Richiedere una conferma prima di azioni sensibili introduce una pausa che può impedire comportamenti involontari, come autorizzare spese a nome tuo. Questi controlli semplici hanno un impatto elevato senza aggiungere complessità significativa.

Cosa significano gli agenti IA per il futuro dell'IA consumer?

Gli agenti IA indicano un futuro in cui gli strumenti IA fanno più che assistere: agiscono. Ma questo passaggio comporta compromessi che i consumatori stanno solo iniziando a imparare a gestire.

Cosa ci dice questo momento sulla maturità degli agenti IA

Gli agenti IA sono potenti ma ancora immaturi. Possono automatizzare attività, ma incontrano difficoltà su aspetti di giudizio e sicurezza. Questo non significa che non diventeranno più sicuri o affidabili in futuro, ma che le aspettative devono rimanere realistiche.

Gli agenti IA mostrano la direzione verso cui si muove la tecnologia, ma un uso diffuso e quotidiano richiederà migliori garanzie di sicurezza e strumenti progettati fin dall'inizio con la tutela dell'utente in mente.

Articoli correlati:

- Come affronta ChatGPT le preoccupazioni di cybersecurity e i rischi potenziali?

- Quali sono i rischi della criminalità informatica basata su AI nello scenario digitale odierno?

- In che modo AI e il machine learning migliorano le difese informatiche?

- Quali sono i pericoli della tecnologia deepfake oggi?

Prodotti consigliati:

Domande frequenti

OpenClaw è scaricabile gratuitamente?

OpenClaw è disponibile per il download su GitHub ed è software open source. Questo significa che chiunque può scaricarlo, esaminarlo, modificarlo e ridistribuirlo.

OpenClaw è facile da configurare?

Esistono tutorial che permettono di far girare bot rapidamente, ma una configurazione avanzata richiede tempo e competenze specialistiche. Proprio per questo motivo, eseguire software che non è stato impostato correttamente può risultare rischioso.