Un nuovo report globale di Kaspersky Security Services, “Anatomy of a Cyber World” , mette in luce un punto cieco nei SOC aziendali: sebbene le performance vengano solitamente misurate in base alla velocità di rilevamento e risposta, le aziende raramente verificano se stiano individuando le minacce corrette. Gran parte dei dati telemetrici raccolti, infatti, non viene inserita nelle pipeline di rilevamento in tempo reale, creando lacune nascoste che le valutazioni interne tendono a trascurare e alimentando così la richiesta di consulenze SOC indipendenti per individuarle.

Mentre le aziende continuano a investire nei Security Operations Center (SOC), misurarne le reali performance resta una sfida complessa. L’efficacia operativa dipende non solo dal volume dei dati raccolti, ma anche dalla capacità di utilizzarli in modo efficace ai fini del rilevamento. Secondo un recente sondaggio di Kaspersky, le aziende valutano generalmente l’efficacia dei SOC attraverso un numero limitato di indicatori chiave di performance: il tempo medio di risposta (MTTR) e il tempo medio di rilevamento (MTTD) dominano il quadro, mentre parametri più approfonditi, come i tassi di falsi positivi o il costo per incidente, restano secondari. La vera domanda, però, non riguarda solo la rapidità con cui il SOC risponde, ma anche la sua capacità di individuare le minacce prima che si aggravino.

I risultati del Kaspersky Security Services Global Report confermano un dato significativo: la maggior parte dei SOC raccoglie molti più dati di quanti ne utilizzi effettivamente per il rilevamento. La copertura media delle regole di correlazione nelle aziende valutate si attesta infatti al 43%, il che significa che, mediamente, la logica di rilevamento attiva copre meno della metà di tutte le fonti di dati acquisite. Il resto rimane nella piattaforma a disposizione per indagini retrospettive, attività di threat hunting o finalità di conformità, ma resta invisibile al rilevamento in tempo reale.

Questa lacuna non è sempre involontaria. Alcuni dati vengono infatti raccolti deliberatamente al di fuori dell’ambito della correlazione attiva, per soddisfare esigenze investigative o normative. Tuttavia, in molti casi, le fonti vengono integrate senza un piano di rilevamento chiaro oppure con lo sviluppo delle regole rinviato e mai completato. Questa situazione è più tipica dei SOC maturi; negli ambienti meno evoluti, invece, i dati vengono spesso raccolti senza essere mai realmente utilizzati. Le ragioni possono essere diverse: dall’integrazione delle fonti prima dello sviluppo pianificato delle regole, a una gestione poco chiara della logica di rilevamento, fino a limitazioni di risorse che rinviano indefinitamente il lavoro di ingegneria. In entrambi i casi, però, il risultato è lo stesso: porzioni significative dell’ambiente restano di fatto non monitorate in tempo reale.

A rendere il quadro ancora più complesso è il fatto che il problema tende ad aggravarsi con la crescita dell’azienda. I SOC che gestiscono i volumi di dati più elevati coprono infatti solo circa il 30% delle proprie fonti con logiche di rilevamento attive. Con l’espansione dell’infrastruttura, la capacità di ingegneria del rilevamento raramente cresce allo stesso ritmo. Le fonti che più frequentemente restano prive di copertura sono la telemetria di rete, i database e i server web: infrastrutture fondamentali che dovrebbero invece essere al centro di qualsiasi strategia di rilevamento.

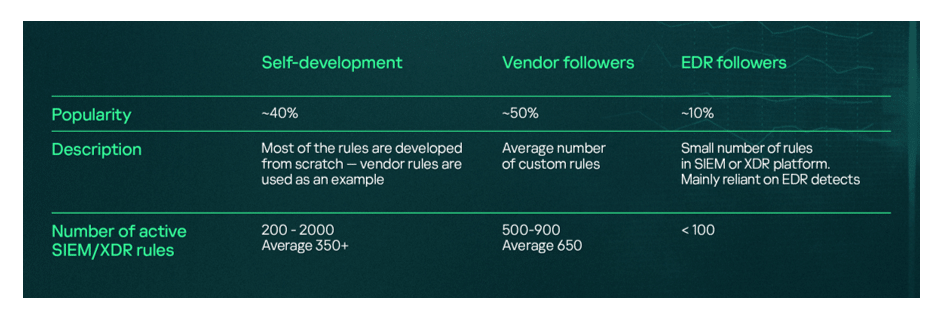

Anche l’approccio alla logica di rilevamento varia notevolmente. Circa il 50% dei SOC valutati si affida principalmente a set di regole forniti dai vendor, mentre circa il 40% costruisce la propria logica da zero. I team che si affidano ai vendor devono spesso affrontare elevati tassi di falsi positivi e lacune di copertura dovute a una messa a punto insufficiente; quelli che dipendono principalmente dall’EDR presentano invece punti ciechi nei casi in cui manca la correlazione tra fonti differenti. Nel frattempo, molte aziende definiscono l’ambito di rilevamento del proprio SOC già nella fase iniziale di progettazione, senza più rivederlo nel tempo: un approccio che porta all’accumulo silenzioso di punti ciechi man mano che l’infrastruttura evolve.

“Anche con l’adozione di KPI ben definiti, valutare internamente l’efficacia

del SOC resta difficile a causa del pregiudizio derivante dalla visione

privilegiata degli addetti ai lavori. Per questo motivo le aziende si rivolgono

sempre più spesso a servizi di consulenza SOC esterni, in grado di valutare la

logica di rilevamento, analizzare i flussi di eventi e simulare attacchi, così

da comprendere cosa venga effettivamente individuato. Per migliorare, le aziende

dovrebbero adottare un processo strutturato di ingegneria del rilevamento: una

disciplina ripetibile per lo sviluppo, la convalida e la revisione periodica

della logica di rilevamento”,ha commentato Roman Nazarov, Head of SOC Consulting di Kaspersky.

“Anche con l’adozione di KPI ben definiti, valutare internamente l’efficacia

del SOC resta difficile a causa del pregiudizio derivante dalla visione

privilegiata degli addetti ai lavori. Per questo motivo le aziende si rivolgono

sempre più spesso a servizi di consulenza SOC esterni, in grado di valutare la

logica di rilevamento, analizzare i flussi di eventi e simulare attacchi, così

da comprendere cosa venga effettivamente individuato. Per migliorare, le aziende

dovrebbero adottare un processo strutturato di ingegneria del rilevamento: una

disciplina ripetibile per lo sviluppo, la convalida e la revisione periodica

della logica di rilevamento”,ha commentato Roman Nazarov, Head of SOC Consulting di Kaspersky.

Per allineare processi interni e tecnologie all’attuale panorama delle minacce, in continua evoluzione, le aziende possono valutare il servizio Kaspersky SOC Consulting, che aiuta a creare un SOC interno da zero, a valutare la maturità di uno già esistente o a potenziare capacità specifiche, come le procedure di rilevamento e risposta. Nel 2025, i progetti di consulenza più richiesti sono stati la Valutazione Tecnica del SOC (23,4%), lo Sviluppo del Framework del SOC (20%) e, a pari merito, la Valutazione della Maturità del SOC e la Garanzia di Qualità SIEM (11,7% ciascuno), a conferma della crescente domanda di maggiore visibilità sulle performance dei SOC.

Per ulteriori informazioni sull’efficacia del rilevamento SOC e sulle misure concrete da adottare per rafforzare il monitoraggio della sicurezza, è possibile consultare il report completo al seguente link.